پلتفرم توسعهدهنده GitLab امروز یک ویژگی امنیتی مبتنی بر هوش مصنوعی را معرفی کرد که از یک مدل زبان بزرگ برای توضیح آسیبپذیریهای بالقوه برای توسعهدهندگان استفاده میکند و برنامههایی برای گسترش این آسیبپذیریها برای رفع خودکار این آسیبپذیریها با استفاده از هوش مصنوعی در آینده دارد.

در اوایل این ماه، این شرکت یک ابزار آزمایشی جدید را معرفی کرد که کد را برای یک توسعهدهنده توضیح میدهد – شبیه به ویژگی امنیتی جدید اعلام شده GitLab – و یک ویژگی آزمایشی جدید که به طور خودکار نظرات مربوط به مشکل را خلاصه میکند. در این زمینه، همچنین شایان ذکر است که GitLab قبلاً یک ابزار تکمیل کد را راهاندازی کرده بود که اکنون در دسترس کاربران GitLab Ultimate و Premium است و ویژگی بررسیکنندگان پیشنهادی مبتنی بر ML آن در سال گذشته.

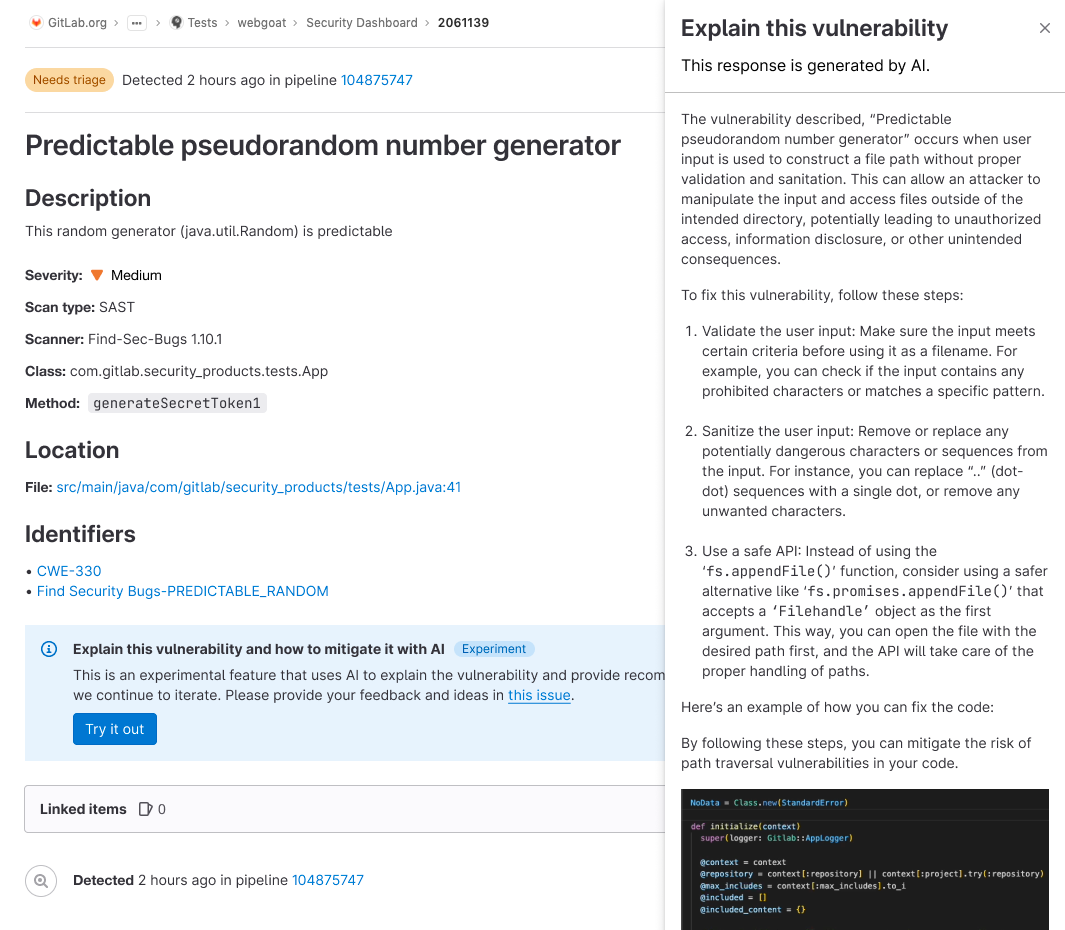

اعتبار تصویر: GitLab

ویژگی جدید «توضیح این آسیبپذیری» سعی میکند به تیمها کمک کند تا بهترین راه را برای رفع آسیبپذیری در چارچوب کد پایه پیدا کنند. این زمینه است که تفاوت را در اینجا ایجاد می کند، زیرا این ابزار قادر است اطلاعات اولیه مربوط به آسیب پذیری را با بینش خاصی از کد کاربر ترکیب کند. این باید رفع این مشکلات را آسانتر و سریعتر کند.

این شرکت فلسفه کلی خود را در پس افزودن ویژگیهای هوش مصنوعی «سرعت با نردههای محافظ» مینامد، یعنی ترکیبی از کد هوش مصنوعی و تولید آزمایش که توسط پلتفرم تمام پشته DevSecOps این شرکت پشتیبانی میشود تا اطمینان حاصل شود که هر آنچه که هوش مصنوعی تولید میکند میتواند با خیال راحت به کار گرفته شود.

GitLab همچنین تاکید کرد که تمام ویژگیهای هوش مصنوعی آن با در نظر گرفتن حریم خصوصی ساخته شدهاند. «اگر ما هستند لمس کردن yما پر فکر ویژگی، که است کد، wه هستند فقط رفتن به بودن در حال ارسال که به آ مدل که است GitLabs یا است در GitLab ابر معماری،» دیوید دسانتو، مدیر ارشد اجرایی GitLab به من گفت. «تیاو دلیل اینکه چرا آن برای ما مهم است – و این به آن برمی گردد شرکت، پروژه DevSecOps – این است ما مشتریان هستند به شدت تنظیم شده است. ما مشتریان هستند معمولا بسیار امنیت و انطباق هوشیار، آگاه، و ما می دانست ما میتوانست نه ساختن آ کد پیشنهادات راه حل که ضروری ما در حال ارسال آی تی به آ سوم-مهمانی – جشن هوش مصنوعی.” او همچنین خاطرنشان کرد که GitLab از داده های خصوصی مشتریان خود برای آموزش مدل های خود استفاده نخواهد کرد.

DeSanto تاکید کرد که هدف کلی GitLab برای ابتکار هوش مصنوعی خود، بهره وری 10 برابری است – و نه فقط کارایی توسعه دهنده فردی، بلکه چرخه عمر کلی توسعه. همانطور که او به درستی اشاره کرد، حتی اگر بتوانید بهرهوری یک توسعهدهنده را 100 برابر کنید، ناکارآمدیهای پاییندستی در بررسی آن کد و تولید آن به راحتی میتواند آن را نفی کند.

“اگر توسعه است 20% از را زندگی چرخه، زوج اگر ما ساختن که 50% بیشتر موثر، شما هستید نه واقعا رفتن به احساس کنید دیسانتو گفت. “اکنون، اگر ما ساختن را امنیت تیم ها، را عملیات تیم ها، را تیم های انطباق همچنین بیشتر کارآمد، سپس مانند یک سازمان، شما هستید رفتن به دیدن آی تی.”

به عنوان مثال، ویژگی «توضیح این کد» نه تنها برای توسعه دهندگان، بلکه برای تیمهای QA و امنیتی کاملاً مفید است، که اکنون درک بهتری از آنچه باید آزمایش کنند، دریافت میکنند. مطمئناً به همین دلیل بود که GitLab آن را گسترش داد تا آسیبپذیریها را نیز توضیح دهد. در درازمدت، ایده در اینجا ساخت ویژگیهایی است که به این تیمها کمک میکند تا به طور خودکار تستهای واحد و بررسیهای امنیتی را تولید کنند – که سپس در پلتفرم کلی GitLab ادغام میشوند.

بر اساس گزارش اخیر DevSecOps GitLab، 65 درصد از توسعه دهندگان در حال حاضر از هوش مصنوعی و ML در تلاش های آزمایشی خود استفاده می کنند یا قصد دارند این کار را در سه سال آینده انجام دهند. در حال حاضر، 36٪ از تیم ها از یک ابزار AI/ML برای بررسی کد خود قبل از اینکه بازبین کد آن را ببینند استفاده می کنند.

دیو استیر از GitLab در اطلاعیه امروز مینویسد: «با توجه به محدودیتهای منابعی که تیمهای DevSecOps با آن مواجه هستند، اتوماسیون و هوش مصنوعی به یک منبع استراتژیک تبدیل میشوند. پلتفرم DevSecOps ما به تیمها کمک میکند که شکافهای مهم را پر کنند، در حالی که بهطور خودکار سیاستها را اعمال میکنند، چارچوبهای انطباق را اعمال میکنند، آزمایشهای امنیتی را با استفاده از قابلیتهای اتوماسیون GitLab انجام میدهند و توصیههایی به کمک هوش مصنوعی ارائه میکنند – که منابع را آزاد میکند.»