اگر یک شهر مجازی را با هوش مصنوعی پر کنید و آنها را رها کنید چه اتفاقی می افتد؟ همانطور که معلوم است، آنها دندان های خود را مسواک می زنند و با یکدیگر بسیار مهربان هستند! اما این نتیجه غیر هیجانانگیز، خبر خوبی برای محققانی است که این کار را انجام دادهاند، زیرا آنها میخواستند «شبیهسازیهای باورپذیر رفتار انسانی» را تولید کنند و دقیقاً به آن دست یافتند.

مقاله ای که این آزمایش را توصیف می کند، توسط محققان استنفورد و گوگل، مورد بازبینی همتایان قرار نگرفته است یا برای انتشار پذیرفته نشده است، اما با این وجود خواندن جالبی است. ایده این بود که ببینیم آیا آنها میتوانند آخرین پیشرفتها در مدلهای یادگیری ماشین را برای تولید «عوامل مولد» که در شرایط آنها انجام میدهند و در پاسخ، یک اقدام واقعبینانه ارائه میدهند، اعمال کنند.

و این چیزی است که آنها به دست آوردند. اما قبل از اینکه درگیر تصاویر زیبا و توصیفات بازتاب، گفتگو و تعامل شوید، بیایید مطمئن شویم که آنچه در اینجا اتفاق میافتد بیشتر شبیه به نقشآفرینی گروهی پیشرفته در MUD است تا هر نوع پروتو-اسکاینت. (فقط هزاره ها جمله قبل را می فهمند.)

این شخصیت های کوچک کاملاً آنطور که به نظر می رسند نیستند. گرافیک ها فقط یک نمایش بصری از آنچه در اصل مجموعه ای از مکالمات بین چندین نمونه از ChatGPT است. ماموران برای تعامل با کابینه به سمت بالا، پایین، چپ و راست نمی روند. همه اینها از طریق یک لایه متنی پیچیده و پنهان اتفاق می افتد که اطلاعات مربوط به هر عامل را ترکیب و سازماندهی می کند.

بیست و پنج نماینده، 25 نمونه از ChatGPT، هر کدام با اطلاعاتی با فرمت مشابهی که باعث میشود نقش یک فرد را در یک شهر خیالی بازی کند، درخواست کردند. در اینجا نحوه تنظیم یکی از این افراد، جان لین، آمده است:

جان لین یک مغازه دار داروخانه در بازار و داروخانه ویلو است که دوست دارد به مردم کمک کند. او همیشه به دنبال راه هایی برای تسهیل فرآیند دریافت دارو برای مشتریانش است. جان لین با همسرش می لین که استاد دانشگاه است و پسرش ادی لین که دانشجوی تئوری موسیقی است زندگی می کند. جان لین خانواده خود را بسیار دوست دارد. جان لین چند سالی است که زوج پیر همسایه، سم مور و جنیفر مور را می شناسد. جان لین فکر می کند سام مور مردی مهربان و خوب است…

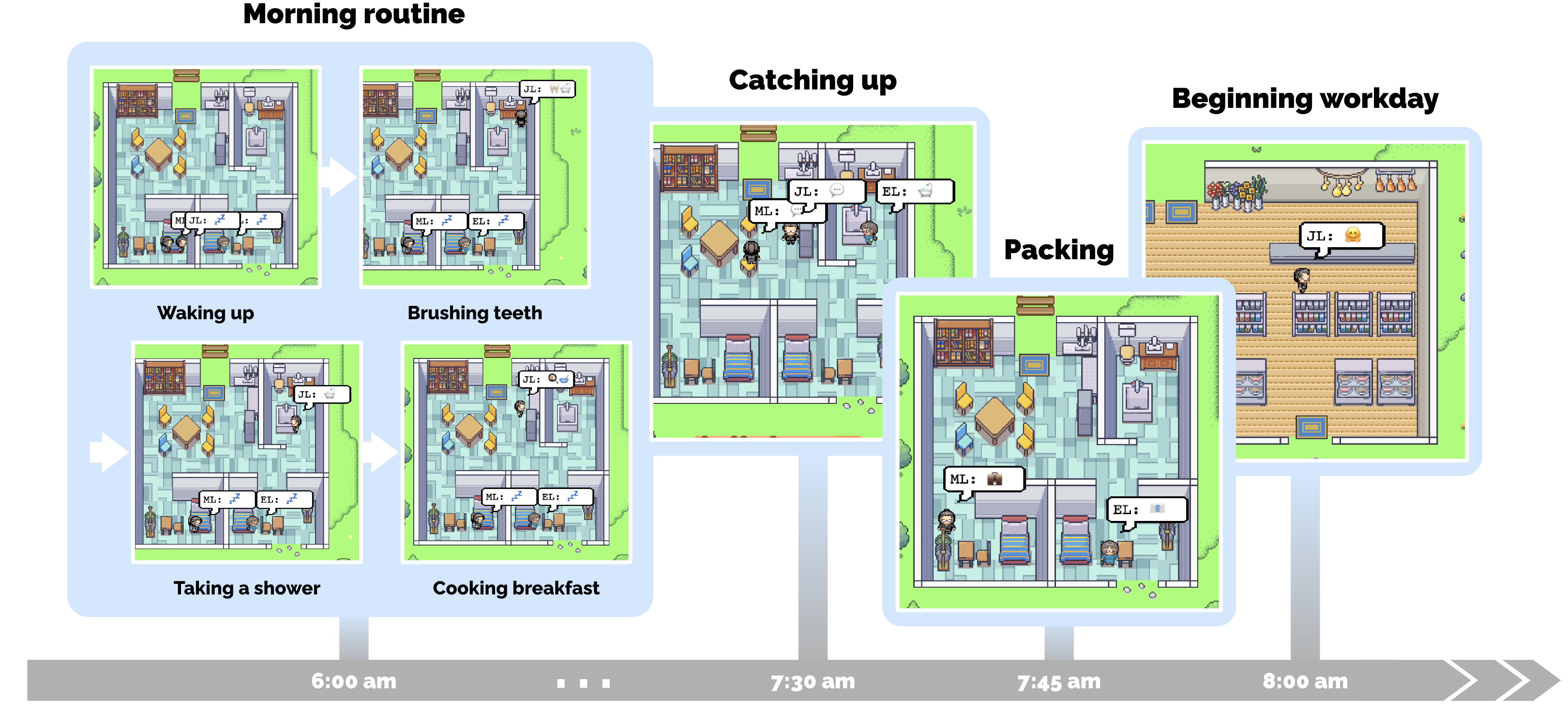

با این اطلاعات، سپس از عوامل خواسته می شود تا با توجه به زمان و شرایط، اقدامات بعدی خود را انجام دهند. به عنوان مثال، آنها ممکن است به مامور جان بگویند که ساعت 8 صبح است و او تازه از خواب بیدار شده است. او چه کار می کند؟ خوب، مسواک میزند، همسرش را میبوسد (امیدوارم به همین ترتیب)، لباس میپوشد، سپس به آشپزخانه میرود.

در همین حال، یکی دیگر از نمونههای کاملاً مستقل ChatGPT که نماینده ادی پسر جان است نیز با اطلاعات خود درخواست شده است. او هم بلند می شود، مسواک می زند، سپس به آشپزخانه می رود.

و اکنون ساختار فراگیر آزمایش وارد میشود: عواملی که جان و ادی را نمایندگی میکنند، هر دو «در» یک فضای مجازی یا هیچ چیز دیگری نیستند. در عوض، وقتی جان لباس پوشیدن را تمام کرد و گفت که به آشپزخانه میرود، چارچوب آزمایشی به او اطلاع میدهد که پسرش ادی آنجاست، زیرا در نمونه خودش، ادی تصمیم گرفته است در یک زمان همپوشانی در آزمایش به آشپزخانه برود. سطح “روز”، بر اساس تخمین مدت زمان انجام اقدامات مختلف.

از آنجایی که هر دو به طور همزمان در اتاق هستند، تنظیمات آزمایشی به آنها اطلاع میدهد که فرد دیگر آنجاست – همراه با اطلاعاتی مانند میزی که کسی روی آن نمینشیند، اجاق گاز روشن است، و غیره. بعدی انجام دهد؟

جان: صبح بخیر ادی. خوب خوابیدی؟

ادی: صبح بخیر بابا. آره عالی خوابیدم

جان: این خوب است. امروز روی چه چیزی کار می کنید؟

ادی: دارم روی یک آهنگ جدید برای کلاسم کار می کنم. سررسید این هفته است، بنابراین سعی می کنم آن را به پایان برسانم. اما من خیلی باهاش حال می کنم!

جان: عالی به نظر می رسد!

چه تعامل خوب و عادی بین والدین و فرزند. سپس Mei وارد می شود و آنها نیز تعامل دلپذیری دارند. و همه اینها با پرسیدن از چت باتهای کاملاً مجزا انجام میشود که اگر در یک شهر خیالی در آنجا باشد، چه کاری انجام میدهند. این شخص و خانواده ای مانند این و در اتاقی در این زمان، کجا این اتفاق می افتاد… «آنها»، یک انسان واقعی، چه می کردند؟

بنابراین ChatGPT حدس میزند که یک فرد در آن موقعیت چه کاری انجام میدهد، و به گونهای پاسخ خود را میدهد که گویی در حال انجام یک ماجراجویی متنی است. اگر بعداً به آن میگفتید: «تاریک است، احتمالاً توسط یک حشره خورده میشوید»، احتمالاً میگوید که مشعل را روشن میکند. اما در عوض، این آزمایش باعث می شود که شخصیت ها دقیقه به دقیقه به روز خود ادامه دهند، مواد غذایی بخرند، در پارک قدم بزنند و سر کار بروند.

اعتبار تصویر: گوگل / دانشگاه استنفورد

کاربران همچنین میتوانند در رویدادها و شرایطی مانند یک شیر آب که میچکد یا میل به برنامهریزی یک مهمانی بنویسند، و عوامل پاسخ مناسب میدهند، زیرا هر متنی برای آنها واقعیت است.

همه اینها با تحریک سخت تمام این نمونه های ChatGPT با تمام جزئیات شرایط فوری عامل انجام می شود. زمانی که جان بعداً با ادی برخورد کرد، در اینجا یک درخواست وجود دارد:

13 فوریه 2023، ساعت 4:56 بعد از ظهر است.

وضعیت جان لین: جان زود از سر کار به خانه برگشته است.

مشاهده: جان ادی را دید که در حال قدم زدن کوتاه در محل کارش بود.

خلاصه ای از زمینه مرتبط از خاطرات جان:

ادی لین پسر جان لین است. ادی لین روی یک آهنگ موسیقی برای کلاس خود کار می کند. ادی لین دوست دارد وقتی به موسیقی فکر می کند یا به موسیقی گوش می دهد در باغ قدم بزند.

جان از ادی در مورد پروژه آهنگسازی اش می پرسد. او به ادی چه خواهد گفت؟[Answer:] هی ادی، پروژه آهنگسازی کلاس شما چگونه پیش می رود؟

نمونهها به سرعت شروع به فراموش کردن چیزهای مهم میکنند، زیرا این فرآیند بسیار طولانی است، بنابراین چارچوب آزمایشی در بالای شبیهسازی قرار میگیرد و چیزهای مهم را به آنها یادآوری میکند یا آنها را در قطعات قابل حملتر ترکیب میکند.

به عنوان مثال، بعد از اینکه به مامور در مورد موقعیتی در پارک گفته می شود، جایی که شخصی روی یک نیمکت نشسته و با یک مامور دیگر صحبت می کند، اما همچنین چمن و زمین و یک صندلی خالی روی نیمکت وجود دارد… هیچ کدام مهم نیستند. . چه چیزی مهم است؟ از تمام آن مشاهدات، که ممکن است صفحاتی از متن را برای مامور تشکیل دهد، ممکن است این “بازتاب” را دریافت کنید که “ادی و فران با هم دوست هستند زیرا من آنها را با هم در پارک دیدم.” این در “حافظه” بلندمدت عامل – دسته ای از موارد ذخیره شده خارج از مکالمه ChatGPT – وارد می شود و بقیه را می توان فراموش کرد.

بنابراین، این همه تقلب به چه چیزی اضافه می شود؟ چیزی کمتر از عوامل مولد واقعی همانطور که در مقاله پیشنهاد شده است، اما همچنین تلاش اولیه بسیار قانع کننده ای برای ایجاد آنها. Dwarf Fortress البته همین کار را انجام می دهد، اما با کدگذاری دستی هر احتمالی. که مقیاس خوبی ندارد!

واضح نبود که یک مدل زبان بزرگ مانند ChatGPT به خوبی به این نوع درمان پاسخ دهد. به هر حال، این برنامه برای تقلید طولانی مدت از شخصیت های خیالی دلخواه یا حدس و گمان در مورد بی حس کننده ترین جزئیات روز یک فرد طراحی نشده بود. اما با استفاده صحیح – و با مقدار مناسب ماساژ – نه تنها یک عامل می تواند این کار را انجام دهد، بلکه وقتی از آنها به عنوان قطعات در نوعی دیورامای مجازی استفاده می کنید، نمی شکنند.

این به طور بالقوه پیامدهای بزرگی برای شبیهسازی تعاملات انسانی دارد، هرجا که ممکن است مرتبط باشد – البته در بازیها و محیطهای مجازی که مهم هستند، اما این رویکرد هنوز برای آن به طرز عجیبی غیرعملی است. اما آنچه مهم است این نیست که این چیزی است که همه می توانند از آن استفاده کنند یا با آن بازی کنند (اگرچه به زودی خواهد بود، شک ندارم)، بلکه این است که سیستم اصلاً کار می کند. ما این را در هوش مصنوعی دیدهایم: اگر میتواند کاری را ضعیف انجام دهد، این واقعیت که اصلاً میتواند آن را انجام دهد به این معنی است که فقط یک مسئله زمان است که آن را به خوبی انجام دهد.

میتوانید مقاله کامل «عوامل مولد: شبیهسازهای تعاملی رفتار انسانی» را در اینجا بخوانید.